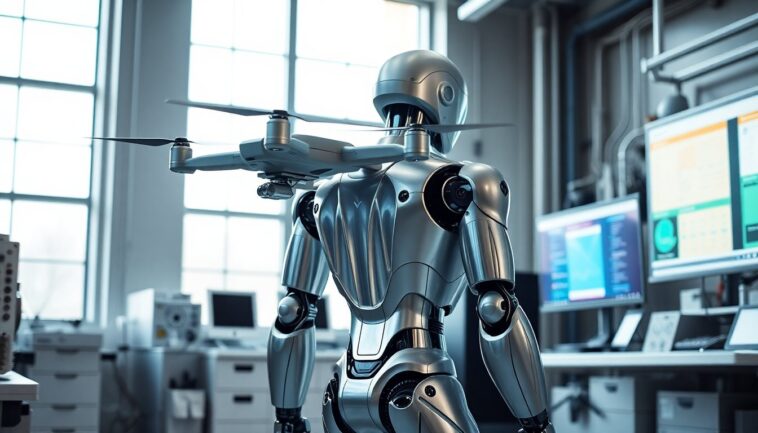

En un avance significativo en el ámbito de la robótica, investigadores del Instituto de Tecnología de California (Caltech) y del Instituto de Innovación Tecnológica (TII) en Abu Dhabi han presentado X1, un sistema multirrobot pionero. Esta innovadora creación combina un robot humanoide con un dron que puede despegar desde su espalda y continuar su trayectoria de manera autónoma. Este proyecto es el resultado de tres años de esfuerzos colaborativos centrados en aprovechar la experiencia combinada en inteligencia artificial, robótica y sistemas de propulsión.

Según Aaron Ames, director del Centro de Sistemas Autónomos y Tecnologías de Caltech (CAST), diferentes robots son más eficaces en distintos entornos. «Los robots ya pueden volar, caminar y conducir, cada uno con sus ventajas. El desafío radica en integrar estas modalidades en un sistema cohesivo, maximizando las fortalezas y minimizando las debilidades», explica. Esta visión se materializa a través del sistema X1, que demuestra su potencial en aplicaciones del mundo real.

Demostrando las capacidades de X1

Recientemente, el equipo llevó a cabo una impresionante demostración en el campus de Caltech, simulando un escenario de emergencia que requería una respuesta rápida. Para esta prueba, adaptaron un robot humanoide comercial de Unitree, modificado para transportar al robot de doble función M4, una máquina capaz de conducir y volar. Esta modificación permitió al humanoide transportar al M4 como si fuera una mochila.

La demostración comenzó en el Laboratorio Gates–Thomas, donde el robot humanoide navegó a través de la Biblioteca Sherman Fairchild antes de llegar a un área designada para el lanzamiento al aire libre.

Al llegar, el robot humanoide se inclinó hacia adelante, permitiendo que el M4 despegara en modo dron. Una vez en el aire, el M4 cambió a su forma de conducción para desplazarse de manera eficiente hacia el sitio de emergencia simulado.

Superando obstáculos con agilidad

Durante su trayecto, el M4 se encontró con el Turtle Pond, una barrera natural que exigió un cambio de nuevo a modo dron.

La capacidad de adaptarse dinámicamente al entorno y superar obstáculos es una característica clave del sistema X1. El M4 voló exitosamente sobre el estanque y continuó su misión hacia la ubicación de emergencia cerca del Caltech Hall, donde se unió a otro robot M4 y al humanoide para asistir en la crisis simulada.

Mory Gharib, figura prominente en el proyecto y director fundador de CAST, subrayó la importancia de la colaboración para lograr tales avances. «Nuestro objetivo es unificar diversas funcionalidades robóticas, creando un sistema fluido que pueda abordar varios desafíos. Esta asociación ha sido fundamental para nuestro éxito», declaró.

Colaboración interdisciplinaria

El desarrollo de X1 requirió una mezcla de conocimientos de diferentes campos. El equipo de Gharib se enfoca en la creación de robots voladores y terrestres junto a sistemas de control avanzados, mientras que el laboratorio de Ames aporta su conocimiento en locomoción y robótica humanoide. Además, el TII ofrece valiosas perspectivas sobre tecnologías de autonomía y sensado aplicables en entornos urbanos. La colaboración también se benefició de la destreza en ingeniería de la Universidad del Nordeste, particularmente en diseño de robots morfables.

Alireza Ramezani, profesor asociado en Northeastern, destacó el ambiente productivo durante la colaboración. «Investigadores de diferentes orígenes abordaron juntos complejos desafíos robóticos, incluyendo percepción, fusión de datos de sensores y diseño de hardware», explicó.

Innovaciones en tecnología a bordo

En una reciente visita a Caltech, los ingenieros del TII colaboraron con sus homólogos para mejorar el M4 con Saluki, un sofisticado controlador de vuelo desarrollado por el TII. Las fases futuras del proyecto buscan integrar sensores avanzados, algoritmos basados en modelos y autonomía impulsada por aprendizaje automático, permitiendo que los robots naveguen y se adapten a su entorno en tiempo real.

Claudio Tortorici, director del TII, amplió sobre el proceso de integración de sensores: «Equipamos a los robots con diversos sensores, incluyendo lidar y cámaras, para recopilar datos sobre el entorno. Esto permite a los robots navegar de forma autónoma de un punto a otro de manera efectiva».

Preparándose para aplicaciones en el mundo real

Según Aaron Ames, director del Centro de Sistemas Autónomos y Tecnologías de Caltech (CAST), diferentes robots son más eficaces en distintos entornos. «Los robots ya pueden volar, caminar y conducir, cada uno con sus ventajas. El desafío radica en integrar estas modalidades en un sistema cohesivo, maximizando las fortalezas y minimizando las debilidades», explica. Esta visión se materializa a través del sistema X1, que demuestra su potencial en aplicaciones del mundo real.0

Según Aaron Ames, director del Centro de Sistemas Autónomos y Tecnologías de Caltech (CAST), diferentes robots son más eficaces en distintos entornos. «Los robots ya pueden volar, caminar y conducir, cada uno con sus ventajas. El desafío radica en integrar estas modalidades en un sistema cohesivo, maximizando las fortalezas y minimizando las debilidades», explica. Esta visión se materializa a través del sistema X1, que demuestra su potencial en aplicaciones del mundo real.1

Según Aaron Ames, director del Centro de Sistemas Autónomos y Tecnologías de Caltech (CAST), diferentes robots son más eficaces en distintos entornos. «Los robots ya pueden volar, caminar y conducir, cada uno con sus ventajas. El desafío radica en integrar estas modalidades en un sistema cohesivo, maximizando las fortalezas y minimizando las debilidades», explica. Esta visión se materializa a través del sistema X1, que demuestra su potencial en aplicaciones del mundo real.2