El 16 de marzo de 2026, Nvidia presentó en el GTC una plataforma que no es solo una nueva GPU sino una reconfiguración del stack para la Inteligencia artificial. La propuesta, llamada Vera Rubin, combina siete chips diseñados para trabajar como un sistema único en racks y PODs de alto rendimiento. Esta arquitectura apunta a reducir tanto el consumo energético como el coste por token, al tiempo que habilita nuevas formas de desplegar agentes y modelos a escala.

En paralelo a la presentación del hardware, el CEO Jensen Huang destacó en el evento que el uso intensivo de IA ya está transformando los flujos de trabajo y la carga laboral: más velocidad en los resultados trae más proyectos y, por ende, mayor actividad humana. Huang reclama equilibrio entre ambición tecnológica y prudencia en la seguridad, una reflexión que acompaña al despliegue de la plataforma.

Qué es Vera Rubin y por qué importa

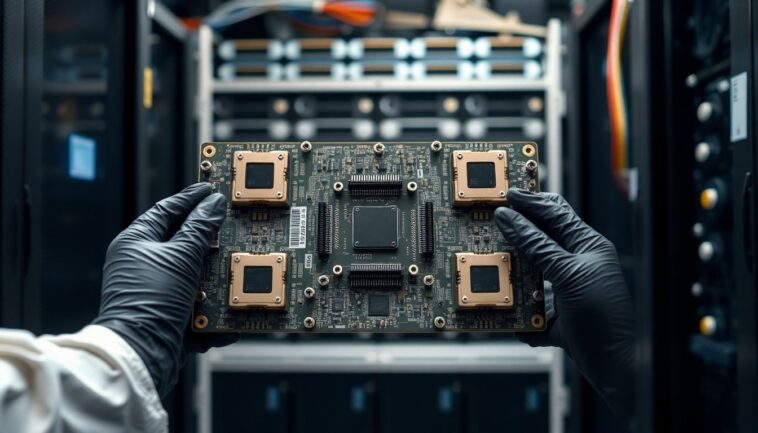

Vera Rubin no es una sola pieza; es un conjunto de siete componentes co-diseñados para funcionar como un superordenador de IA a nivel de rack. La configuración principal, el NVL72, agrupa GPUs Rubin, CPUs Vera y una interconexión de alta velocidad para ofrecer ancho de banda masivo y latencias reducidas. El objetivo es mejorar el throughput de inferencia por vatio y abaratar las operaciones de producción para modelos grandes.

Los siete chips y su papel

Entre los elementos del sistema están un procesador ARM personalizado, el acelerador de entrenamiento e inferencia, una DPU para tareas de infraestructura y switches de última generación. Esta combinación busca optimizar tanto el entrenamiento como la inferencia y, especialmente, el escalado agentic: la capacidad de ejecutar miles de agentes de IA de forma concurrente y eficiente. Para founders y equipos infra, esta configuración redefine el trade-off entre coste y rendimiento.

Cómo cambia la economía de la IA para empresas y startups

Las cifras presentadas por Nvidia hablan de mejoras sustanciales: hasta diez veces más eficiencia energética en inferencia y una reducción drástica del coste por token. En la práctica, esto significa que productos con alto volumen de consultas verán márgenes mejores y nuevas oportunidades de negocio. Además, la oferta en distintos tamaños de rack facilita que no solo los hiperescalares sino también empresas medianas adopten la tecnología.

Nemotron Coalition y modelos abiertos

Paralelamente, Nvidia lanzó la Nemotron Coalition, una iniciativa para co-desarollar modelos abiertos con laboratorios y empresas del ecosistema. El enfoque combina acceso a cómputo en DGX Cloud con contribuciones de datos y conocimiento, para generar una familia de modelos abiertos de frontera. Esto amplía las opciones para startups que prefieren construir sobre software abierto en lugar de depender exclusivamente de APIs propietarias.

Perspectiva humana, seguridad y la visión de Jensen Huang

Huang subraya que la adopción masiva de IA está acelerando el ritmo de trabajo: los resultados vuelven más rápido, aparecen más proyectos y los responsables se ven más ocupados. Sin embargo, también alerta sobre la importancia de establecer límites claros en la funcionalidad de los sistemas: que la tecnología no prometa capacidades que no pueda garantizar y que respete la legislación vigente.

En materia de seguridad, Huang enfatiza la necesidad de agentes defensivos que actúen como células inmunitarias digitales: sistemas agentic capaces de detectar y neutralizar intrusiones al instante. Su horizonte para Nvidia incluye millones de agentes trabajando 24/7 y una plantilla que crezca según la necesidad, todo orientado a resolver problemas que hace una década parecían imposibles.

Implicaciones prácticas y decisiones de infraestructura

Para los responsables de producto y CTOs, Vera Rubin plantea preguntas concretas: cuándo migrar cargas a infraestructuras basadas en la nueva plataforma, cómo recalcular precios de inferencia y qué modelos arquitectónicos favorecen la latencia y el coste. La modularidad en configuraciones de rack y el respaldo de actores como OpenAI, Anthropic y Meta indican que la adopción por parte de los proveedores cloud será un factor clave en los próximos 12-24 meses.

En resumen, la llegada de Vera Rubin y las declaraciones de Jensen Huang configuran un panorama donde la IA agentic se vuelve técnicamente viable y económicamente más atractiva. A la vez, la narrativa enfatiza la necesidad de humildad y prudencia en la implementación para evitar alarmismos y priorizar la seguridad y la responsabilidad.