Meta ha diseñado una familia de aceleradores propios denominada MTIA para satisfacer la creciente demanda de inferencia en sus servicios. En lugar de depender exclusivamente de proveedores tradicionales como Nvidia, AMD, Intel o ARM, la compañía ha creado un ecosistema de silicio que prioriza eficiencia energética y rendimiento en producción. El emblema más notable de esta estrategia es un superchip de 1700W capaz de alcanzar alrededor de 30 PFLOPs y de alojar hasta 512GB de HBM, diseñado para trabajar en conjunto con el resto de la familia MTIA.

Este conjunto de chips no es solo experimentación: Meta afirma haber desplegado cientos de miles de unidades en entornos reales para tareas como clasificación, recomendaciones y publicidad personalizada. La apuesta se sostiene en una pila completa optimizada para sus cargas, donde la combinación de hardware especializado y software común permite un equilibrio entre coste y latencia que, según la compañía, mejora la eficiencia respecto a soluciones genéricas.

Arquitectura modular y compatibilidad física

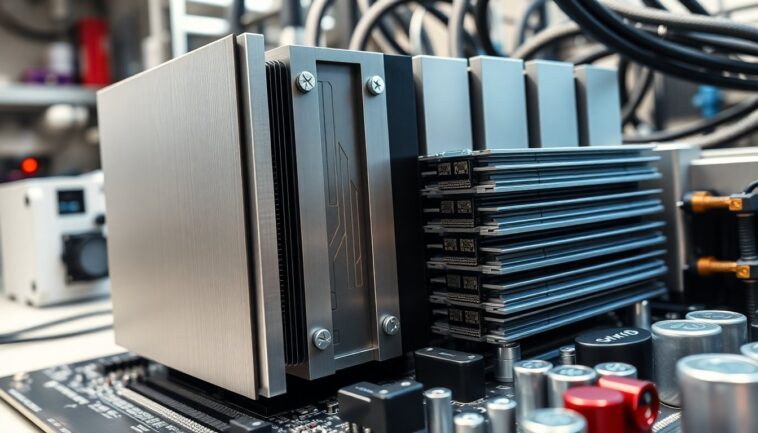

La línea MTIA utiliza una arquitectura basada en chiplets y un diseño modular que facilita la sustitución y la actualización sin remodelar centros de datos. Gracias a este enfoque, nuevas generaciones comparten chasis, red y montaje en rack, lo que permite que un nuevo acelerador entre en producción manteniendo la misma huella física. Esa compatibilidad reduce el tiempo de despliegue y permite iterar con rapidez: Meta ha adoptado un ritmo de lanzamiento más acelerado que el habitual en la industria, con nuevos nodos pensados para encajar en la infraestructura existente.

Prioridad en inferencia y memoria como cuello de botella

En el corazón del diseño de MTIA está la idea de que la limitación principal para inferencia es el ancho de banda y la capacidad de memoria. Meta sostiene que incrementar la velocidad y la cantidad de HBM —la memoria de alta velocidad integrada con los aceleradores— es más eficaz para cargas de servicio que optimizar solo para entrenamiento. Por eso las generaciones más avanzadas elevan de forma sustancial tanto el ancho de banda HBM como la capacidad, permitiendo modelos de inferencia más grandes y respuestas más rápidas en producción.

Generaciones y enfoque de uso

La familia MTIA abarca varias generaciones orientadas a distintos roles: algunos chips están ya en producción para tareas de ranking y recomendaciones, mientras que las iteraciones siguientes se orientan explícitamente a inferencia de modelos generativos y a cargas de alta concurrencia. Aunque pueden manejar entrenamiento, su diseño prioriza la densidad y el coste por inferencia, una decisión estratégica para servicios con millones de consultas diarias.

Software, ecosistema y coexistencia con otras soluciones

La interoperabilidad fue clave en el diseño: MTIA es compatible con marcos de uso extendido como PyTorch, vLLM y Triton, lo que facilita portar modelos y orquestar flujos de inferencia sin rehacer la capa de software. Además, Meta reconoce que ningún chip es suficiente para todas las cargas: por eso combina sus propios aceleradores con GPUs de terceros para entrenamiento a gran escala y con otros silicios cuando la tarea lo requiere. Esta segmentación permite aprovechar lo mejor de cada arquitectura y optimizar costes operativos.

Alianzas y cadena de suministro

Aunque Meta desarrolla el diseño lógico y funcional de MTIA, trabaja con integradores y socios para la implementación física y escalado. Ese modelo refleja lo intensivo en capital de la producción de ASICs y la necesidad de socios que integren placas, interconexión y redes. Paralelamente, la convergencia en herramientas de software facilita la portabilidad entre distintas plataformas, lo que puede permitir a los equipos mover cargas con menor fricción.

Implicaciones y panorama competitivo

La estrategia de Meta encaja en una tendencia mayor: los grandes proveedores de la nube y las plataformas digitales están creando silicio a medida para separar la trayectoria de inferencia de la de entrenamiento. Mientras las GPUs siguen dominando el entrenamiento a gran escala, chips especializados como los MTIA buscan capturar el volumen masivo de inferencias operativas con componentes más eficientes en coste y energía. Para las empresas y desarrolladores, esto significa mayor diversidad de opciones y oportunidades para optimizar despliegues según la naturaleza de la carga.

En conjunto, la apuesta de Meta por un superchip de 1700W con 30 PFLOPs y hasta 512GB de HBM, combinada con una familia modular de MTIA y compatibilidad con herramientas estándar, define una hoja de ruta clara: priorizar la eficiencia en producción, facilitar actualizaciones rápidas y mantener flexibilidad operativa al trabajar junto a otros proveedores cuando convenga.