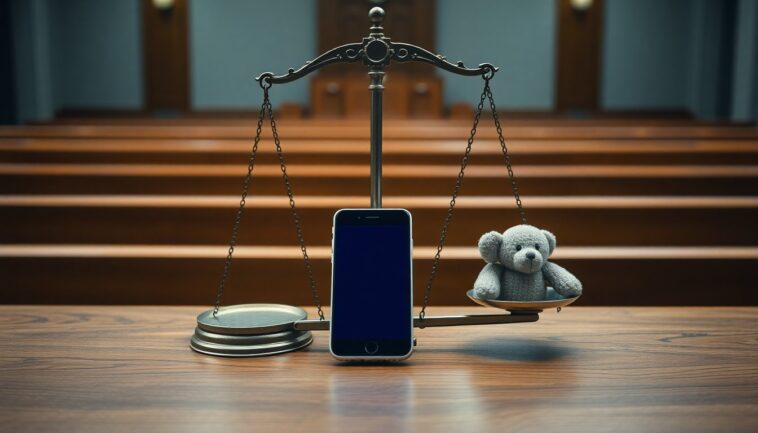

El 21/03/2026 un jurado en un juicio emblemático formuló una pregunta que cambió el tono de la sesión: ¿deben Meta o YouTube responder económicamente por permitir que una niña se enganchará a sus servicios? Ese interrogante, planteado por los propios jurados, ha reavivado el debate público sobre cómo las grandes plataformas gestionan el contenido y el diseño de sus productos. En este contexto, adicción a redes sociales se entiende como un patrón persistente de uso que afecta la vida diaria y el bienestar emocional, y la duda de los jurados apunta directamente a la posibilidad de establecer responsabilidad civil por esos daños.

La repercusión va más allá del caso particular: si el fallo determina que existe responsabilidad, podría obligar a las compañías a afrontar indemnizaciones y a revisar sus algoritmos y políticas de moderación. Para la industria, esto representa un riesgo tanto legal como financiero; para las familias, la promesa de obtener reparación por un daño emocional causado por plataformas que priorizan la monetización del tiempo de pantalla. El gesto del jurado convierte al proceso en una prueba de cómo los tribunales interpretan la relación entre el diseño digital y la salud pública.

Qué ocurrió en la audiencia

Durante la sesión judicial los jurados solicitaron aclaraciones sobre la responsabilidad que tendrían las plataformas si se demostrara que su diseño facilitó la adicción de una menor. La pregunta no condena por sí misma a ninguna empresa, pero sí evidencia que el jurado considera plausible que el funcionamiento de las apps pueda contribuir a un daño que, de quedar probado, requeriría reparación. En el centro del caso está el relato de una familia y la evidencia técnica sobre cómo los algoritmos de recomendación y las funciones de retención de usuarios incrementaron el tiempo de exposición de la menor, provocando perjuicios en su vida cotidiana.

Implicaciones legales y económicas

Si el veredicto contempla responsabilidad, las consecuencias serán múltiples: por un lado, la posibilidad de compensaciones económicas a las víctimas; por otro, la presión para modificar prácticas de diseño de producto y modelos de negocio basados en el engagement. Los abogados discuten si el caso podría crear un precedente legal que facilite demandas similares y si las empresas tendrán que adoptar medidas proactivas para mitigar riesgos.

Además, un fallo adverso podría afectar la valoración de mercado de las plataformas y obligar a cambios regulatorios coordinados por reguladores nacionales e internacionales.

Reacciones y posibles escenarios

Las primeras reacciones combinan cautela y alarma: las compañías implicadas han señalado que velan por la seguridad de los usuarios y que revisan políticas de uso, mientras que defensores de consumidores ven la posibilidad de un avance en protección digital. Dos caminos parecen plausibles: un acuerdo extrajudicial que incluya compensaciones y compromisos de cambios técnicos, o un fallo judicial que siente un marco para futuras reclamaciones. En cualquiera de los escenarios, el resultado puede impulsar mayor transparencia sobre cómo funcionan los algoritmos y la responsabilidad corporativa en relación con la salud mental.

Qué significa para los usuarios

Para quienes usan estas plataformas, el caso subraya la necesidad de mayor información y control sobre la experiencia digital. La presión judicial podría traducirse en nuevas herramientas de seguridad, límites de exposición y opciones de personalización que reduzcan la retención forzada de atención. En términos prácticos, las familias podrían encontrar vías legales para buscar reparación por daños probados, mientras que la conversación pública sobre prevención y educación digital se intensificará. La aparición de medidas concretas dependerá de si el veredicto o los acuerdos incluyen obligaciones de transparencia y cambios en el diseño de las interfaces.

Qué pueden hacer las empresas

Las plataformas enfrentan un incentivo para anticiparse: revisar sus métricas de éxito, auditar algoritmos y mejorar herramientas de protección para menores. Adoptar prácticas de seguridad por diseño, colaborar con expertos en salud pública y ofrecer opciones claras de control a los usuarios son pasos que podrían reducir exposición a demandas. Además, documentar las decisiones de producto y demostrar esfuerzos de mitigación será clave en futuras litigaciones. En suma, la pregunta del jurado del 21/03/2026 marca un punto de inflexión en la relación entre tecnología, derecho y bienestar social.