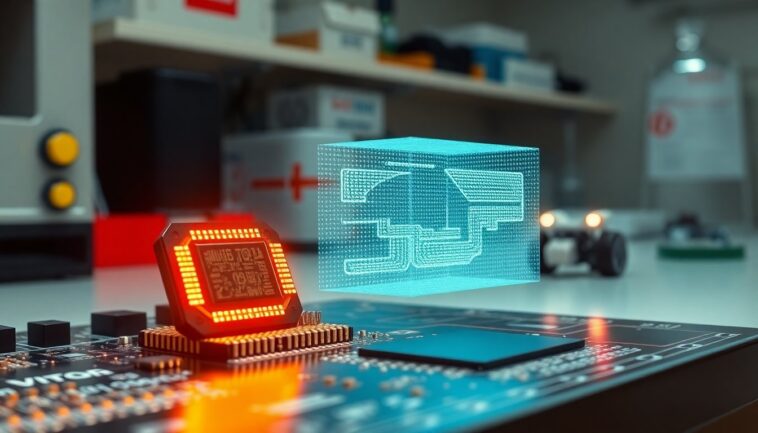

La visión de las máquinas acaba de dar un paso hacia adelante con un diseño que une posición y movimiento en un solo componente. Los sistemas actuales emplean sensores que ofrecen mapas tridimensionales, pero suelen tardar en estimar la velocidad de objetos o requieren equipos pesados y caros. Investigadores han presentado un chip capaz de producir mapas 3D del entorno mientras calcula de forma simultánea la velocidad y la distancia de los objetos en escena, una aproximación denominada imagen 4D.

Este trabajo fue publicado en la revista Nature el 13/03/2026 13:20 y plantea alternativas para dispositivos móviles y vehículos aéreos no tripulados.

Más allá de la novedad, el valor del diseño reside en su integración y eficiencia. Al combinar sensado y procesamiento en una arquitectura on-chip, el sistema reduce la latencia y el consumo energético frente a arreglos tradicionales que transmiten datos voluminosos a módulos externos.

La capacidad de seguir objetos en movimiento con precisión instantánea prepara a la robótica y a los drones para entornos más dinámicos: calles con peatones, almacenes con operadores o escenas deportivas. La propuesta mantiene la exactitud de las lecturas de distancia mientras añade la dimensión temporal necesaria para inferir velocidad sin depender de cámaras múltiples o sistemas LiDAR masivos.

Principio de funcionamiento y diseño

El corazón del avance es una arquitectura de detección que mide ecos y cambios en el tiempo para derivar movimiento.

En lugar de limitarse a capturar profundidad en un instante, el sensor 4D registra la evolución temporal de las señales recibidas, lo que permite calcular tanto la distancia como la velocidad de los objetos. Esta estrategia se apoya en técnicas de procesamiento integradas, que ejecutan algoritmos de correlación y filtrado directamente en el chip, minimizando la necesidad de transmisión de datos brutos. El resultado es una imagen 3D enriquecida con vectores de velocidad que ofrece una visión más completa y útil para la toma de decisiones en tiempo real.

Otro aspecto clave del diseño es la miniaturización y el coste. Al consolidar funciones que antes requerían múltiples módulos, el sistema reduce el tamaño físico y el número de componentes externos. Esto abre la puerta a integrar la tecnología en plataformas donde antes no era viable: robots domésticos, cámaras de seguridad inteligentes y vehículos ligeros. Además, al disminuir la latencia, se mejora la seguridad y la reactividad en aplicaciones críticas, como la evitación de obstáculos o la sincronización con actuadores en entornos colaborativos.

Sensores y algoritmos en la práctica

En el nivel operativo, el equipo combina elementos de tiempo de vuelo y procesamiento de señales para obtener mediciones robustas. Los sensores capturan retornos de pulso y el chip aplica algoritmos de extracción de movimiento que identifican desplazamientos incluso en escenas con ruido y reflejos complejos. El uso de algoritmos embebidos permite detectar cambios instantáneos y estimar vectores de velocidad sin depender de frames sucesivos de cámaras convencionales. Este enfoque mejora la resiliencia frente a condiciones adversas de iluminación y a superficies difíciles, proporcionando una herramienta efectiva para tareas donde la percepción rápida y fiable es esencial.

Aplicaciones, ventajas y retos

La combinación de mapas 3D con información de movimiento tiene aplicaciones diversas: navegación autónoma, logística, inspección industrial y seguridad. En logística, por ejemplo, un robot con este chip puede anticipar la trayectoria de una caja que cae y evitar colisiones. En seguridad, cámaras equipadas con esta tecnología pueden distinguir entre una persona que camina y un objeto lanzado, mejorando las respuestas automatizadas. La ventaja principal es ofrecer percepción en tiempo real sin sacrificar portabilidad ni incrementar costes de forma significativa.

No obstante, quedan desafíos por resolver antes de una adopción masiva. La integración con sistemas existentes, la optimización para producción a gran escala y la validación en escenarios muy variados son pasos pendientes. Además, habrá que balancear la precisión con el consumo energético en aplicaciones de batería limitada. Aun así, la publicación en Nature y la demostración de conceptos prácticos indican que esta línea de investigación tiene potencial para transformar cómo los robots y los drones perciben y reaccionan al mundo en movimiento.

Perspectivas y próximos pasos

Los autores proponen continuar mejorando la resolución espacial y la eficiencia del procesamiento integrado, así como validar el sistema en entornos reales y variados. La combinación de hardware compacto y software optimizado sugiere que, con iteraciones adicionales, la visión 4D en un chip podría convertirse en un estándar para plataformas autónomas y dispositivos conectados. El avance marca un hito en percepción sensorial y muestra cómo la integración inteligente de sensores y cómputo puede abrir nuevas capacidades prácticas para la industria y la investigación.